- 签证留学 |

- 笔译 |

- 口译

- 求职 |

- 日/韩语 |

- 德语

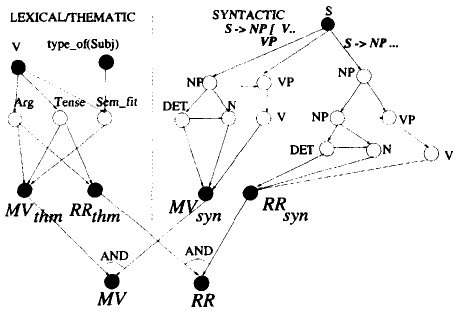

包括MacDonald(1993)和Jurafsky(1996)在内的一些文献中指出,无论语言知识的使用是否具有时间进程的差异,所有这些约束从根本上讲都是概率性的。例如,Jurafsky(1996)的贝叶斯句法处理模型显然是概率性的,Narayanan and Jurafsky(1998)使用概率来解释上面的例句(12.29)至例句(12.31)以及类似的花园幽径句中的难点,也是概率性的。在他们的模型中,人的语言处理取一个歧义的输入句子,计算出若干个不同的并行解释。对于每个这样的解释指派一个概率,使用贝叶斯信念网络(belief network),把PCFG概率、句法概率、主题概率和次范畴化概率以及其他上下文概率结合起来。例如,当人在处理例句(12.29)时,使用图12.8中的信念网络,在看了前面的少数几个单词(The horse raced)之后,贝叶斯模型给例句(12.29a)和例句(12.29b)中的树指派主要动词(Main Verb,简称MV)解释以及简化关系从句(Reduced-Relative,简称RR)解释的概率。这样要把多个概率事实的资源结合起来,例如动词raced是及物动词的概率(即raced带直接宾语),horse是奔跑事件(racing event)的主题Theme的概率,名词短语包含一个简化关系从句的句法概率。由于race更倾向于作为及物动词(带一个直接宾语)而不倾向于作为不及物动词,又由于简化关系从句本身的概率很低,如例句(12.29a)和例句(12.29b)所示,模型预言raced为主要动词MV解释的概率是为简化关系从句RR解释的概率的300倍。

图1

图1把PCFG和次范畴化概率、主题概率以及其他词汇概率结合起来的信念网络,表示对于输入的样本句子究竟为主要动词(MV)解释还是为简化关系从句(RR)解释的支持程度

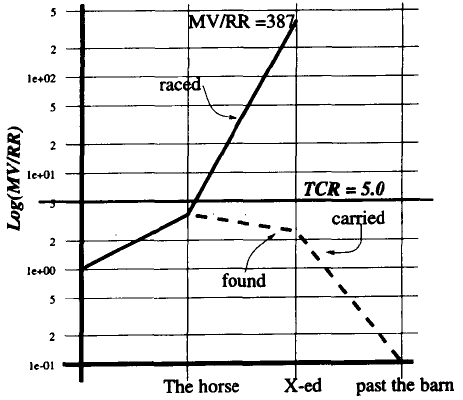

这个模型进一步假定人们不能在同一时间内保持很多的解释。这或者是由于人们的记忆有限,或者是由于他们强烈地希望选择一个简单的解释,这样就把那些级别低的解释修剪掉了。Jurafsky(1996)和Narayanan and Jurafsky(1998)假定,如果某一个概率比最高的概率解释低5倍,那么这样的解释就要被修剪掉。其结果使得人们有时会把那些正确的解释修剪掉,而保持了那些得分很高但实际上不正确的解释。正是因为这个原因,在例句(12.29)中,当人剖析前一段时,概率低(但“正确”)的简化关系从句RR解释就被修剪掉了。

这个模型也可以解释为什么一些表面上看起来相似的句子不会造成花园幽径句。例如,在例句(12.34)中(Pritchett,1988;Gibson,1991),由于动词found是一个及物动词,所以found的简化关系从句的解释的概率大大高于race的简化关系从句的概率。

The bird found in the room died. (12.34)

图2说明了The horse raced和The horse found在MV/RR概率比值上的差别。

图2 raced的后概率比值MV/RR处于阈值之上,因此解释RR被修剪。found和carried的MV/RR都处于歧义消解区域内(Narayanan and Jurafsky,1998)

使用同样的概率区分方法,这个模型也可以解释例句(12.30)中的花园幽径效应;例如,P(N→houses)大于P(V-→houses),等等。Narayanan和Jurafsky的模型还是很初步的,这个模型主要根据相对简单的独立性假设和很粗糙的概率模型;当前研究的关键焦点是确切地理解当人处理句子时究竟存储了什么概率?这些概率是怎样动态结合起来的?

责任编辑:admin