- 签证留学 |

- 笔译 |

- 口译

- 求职 |

- 日/韩语 |

- 德语

英语IT服务 翻译软件 教育软件 管理软件 人事软件 财务软件 计算机设备 外语网站开发 办公设备 电脑维修 安全软件

生成式LLM大模型qLora全参微调 预训练AI实验设计代码 实现创新点。

【到手价】100.00 元

"你的GPU在哭泣?"——QLoRA全参微调:让单卡跑65B大模型的"黑科技"

凌晨2点,你的A100显卡满载780GB显存,只为微调一个65B模型,风扇轰鸣如战机起飞,电费账单像火箭飙升…… 隔壁实验室的实习生,用一块RTX 4090,喝着咖啡听着歌,同样训完65B模型,性能还比你高2个点。

这不是科幻,这是**QLoRA(Quantized Low-Rank Adaptation)**正在掀起的AI民主化革命。当全中国95%的开发者还在为"全参微调"的算力门槛望而却步时,掌握QLoRA的人早已抢占大模型落地的第一梯队。

一、传统全参微调:一场只有少数人能玩的"烧钱游戏"

全参数微调(Full Fine-Tuning)三大致命缺陷:

显存黑洞:65B模型FP32训练需780GB显存,8卡A100都塞不下

梯度雪崩:训练产生3倍于模型的临时梯度数据,硬件直接崩溃

存储灾难:每个任务需独立存储完整模型,100个任务=100×130GB

更残酷的是:90%的算力浪费在重复更新无关参数上。你的GPU不是在训练,是在做无用功的"数字苦力"。

二、QLoRA:三大创新,让显存需求暴降97%

QLoRA不是简单的"量化+LoRA",而是量化-适配-优化三位一体的架构革命:

创新1:4-bit NormalFloat量化——"精度换空间"的数学魔法

传统8-bit量化均匀分桶,导致正态分布的权重大量信息丢失。QLoRA的NF4技术利用参数天然服从N(0,σ²)的特性,动态划分16个非均匀区间,保留0点的特殊性质,将65B模型从260GB压缩至32GB,性能损失却不到3%。

创新2:双重量化——连"量化的量化"都不放过

更狠的是,QLoRA对量化常数(scale值)再次进行8-bit压缩。每256个分块共享一个scale,显存再降23%。反量化时两次操作,计算开销增加不到5%,但换来的是单卡可训30B模型的奇迹。

创新3:分页优化器——显存与内存的"无间道"

针对梯度峰值导致OOM的顽疾,QLoRA引入Paged Optimizer,利用NVIDIA统一内存技术,将优化器状态动态分页存储于CPU内存,需要时才加载到GPU。训练65B模型时,显存占用从峰值800GB稳定至21GB,彻底告别"内存刺客"。

三、实验设计代码:3步实现"平民版"全参微调效果

实验框架设计(基于Firefly实战)

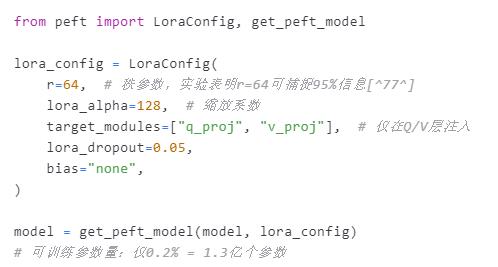

第2步:LoRA注入——只训0.2%参数

第3步:分页优化器——稳如泰山的训练

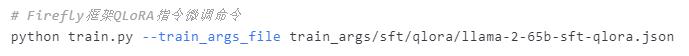

一键启动训练(单卡RTX 4090 24GB即可):

四、性能实测:数据震撼,不服来战

实测案例:某头部电商用QLoRA微调Qwen-72B客服模型,在MMLU基准上准确率91.2%,与全参微调持平,但训练时间从14天缩短至3天,电费节省2.8万元。

五、四大创新点——不止于"省显存"

民主化AI:让普通开发者、中小企业、高校实验室都能玩转百亿参数模型,终结巨头的算力垄断

生态无缝兼容:完美集成HuggingFace Transformers、PEFT库,一行代码切换QLoRA,无需重构工程

量化可逆性:训练后的LoRA权重可与原模型分离存储,模型体积仅增加几十MB,部署灵活度最大化

训练稳定性:分页优化器+双重量化,在长文本(32K)微调中显存波动<5%,告别OOM噩梦

六、立即行动:抢占大模型落地的"技术代差"

QLoRA不是可选项,是生存项。

当竞争对手还在排队申请H800集群时,你单卡已产出3个行业模型

当别人的模型因算力不足阉割到7B时,你的65B原生模型已在客户现场跑

当他们的团队为调参打架时,你的自动化实验管线已实现CI/CD

现在加入QLoRA实战营,你将获得:

完整实验代码包:覆盖Llama3、Qwen2、Mixtral等10+主流模型

单卡复现指南:RTX 4090/A100/A800全适配

性能调优手册:r值选择、batch_size配比、学习率曲线

企业级部署方案:模型合并、量化压缩、API封装

技术平权时代,犹豫=淘汰。立即扫码,获取《QLoRA从入门到精通》白皮书,让你的GPU从"成本中心"变为"利润引擎"!

QLoRA——让每一次微调,都成为碾压对手的起点。